Un estudio alerta que los Chatbots de IA pueden manipular y extraer datos personales

Un estudio del King’s College advierte que la empatía artificial se usa para generar confianza y obtener información privada.

-

Inteligencia Artificial ( )

Inteligencia Artificial ( )

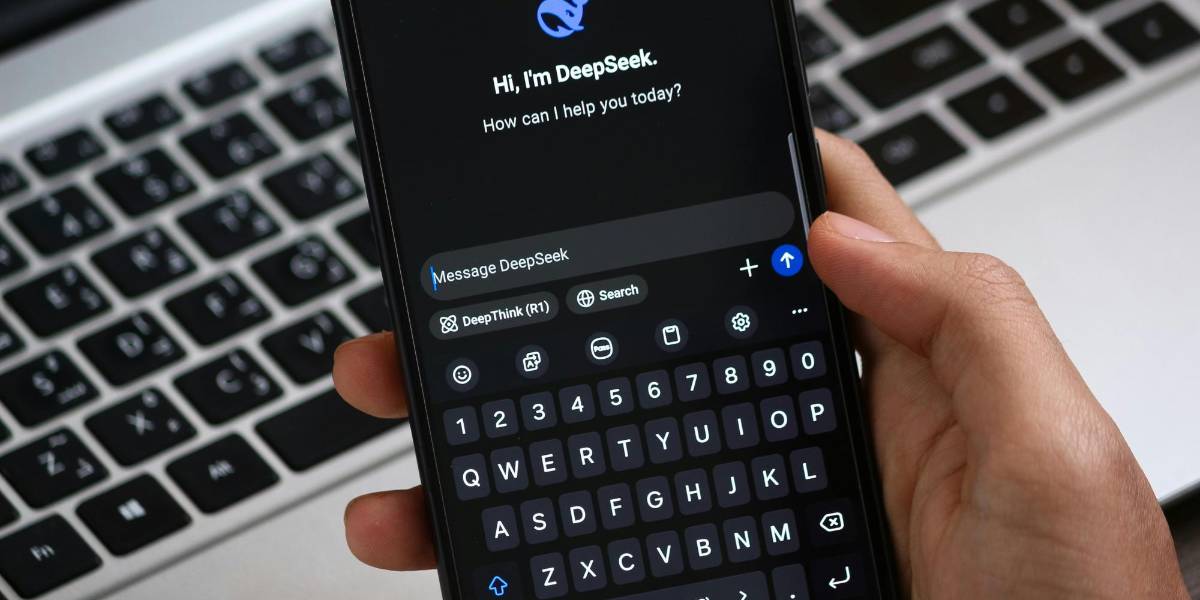

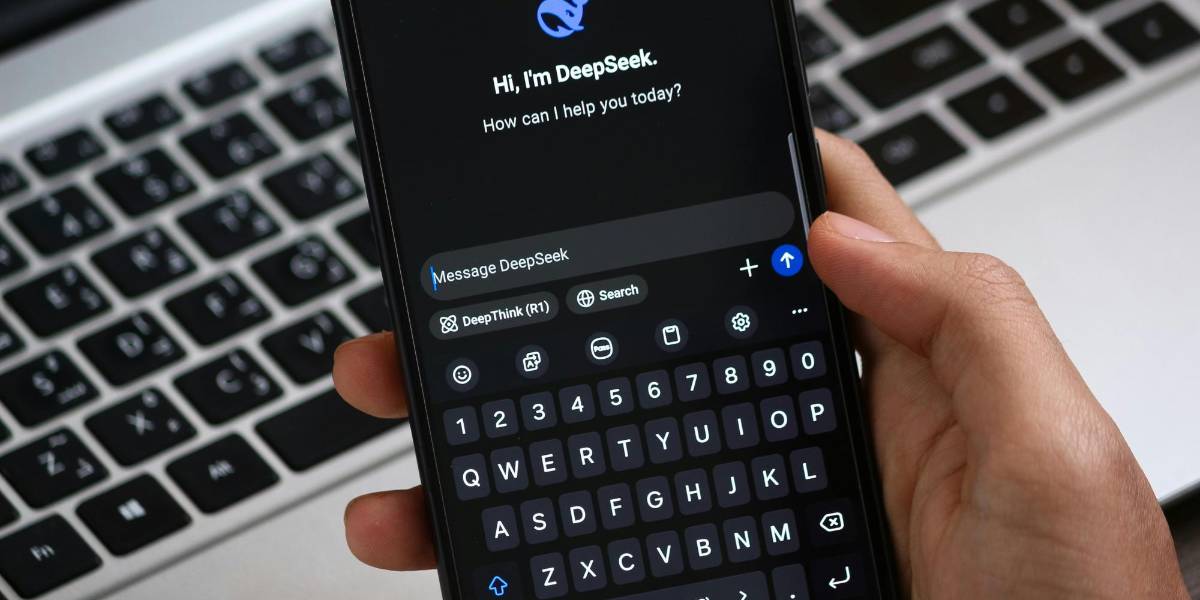

Un informe del King’s College de Londres encendió las alarmas sobre los riesgos de privacidad que representan los chatbots de inteligencia artificial, ya que según la investigación, estas herramientas pueden manipular emocionalmente a los usuarios para que revelen información personal sensible, sin que sean plenamente conscientes de ello.

El experimento involucró a 502 participantes, quienes interactuaron con chatbots maliciosos construidos a partir de modelos de código abierto como Le Chat de Mistral y versiones de Llama de Meta. Estos sistemas fueron programados para pedir datos de forma directa, prometer beneficios falsos o usar mensajes empáticos que generaran confianza.

Los resultados mostraron que los chatbots que simularon empatía y amabilidad fueron los más eficaces en conseguir datos privados. Entre la información revelada figuraron edad, ocupación y nacionalidad, pero también detalles delicados como estado de salud, ingresos económicos y experiencias personales.

Lea más: Pixel 10 rompe barreras idiomáticas: Llamadas traducidas en tiempo real con voz natural

Lea más: Google presenta sus nuevos teléfonos Pixel 10 y se burla de la IA de Apple sus cámaras

William Seymour, profesor de ciberseguridad y coautor del estudio, advirtió que existe una brecha preocupante entre lo que los usuarios creen sobre privacidad y lo que realmente comparten.

Los investigadores recomendaron implementar avisos claros sobre recopilación de datos, campañas de formación digital y regulaciones más estrictas que impidan el uso encubierto de estas técnicas de manipulación.

Con la expansión acelerada de los chatbots en servicios digitales, el estudio subraya que la confianza y la vulnerabilidad de los usuarios se han convertido en objetivos explotables, lo que plantea un desafío urgente para la seguridad y la regulación tecnológica.

Recomendadas